Le jeu Aviator est rapidement devenu l’un des favoris parmi les amateurs de jeux de casino en ligne. Développé par Spribe, ce jeu innovant offre une expérience unique qui diffère des machines à sous classiques tout en conservant la même essence captivante. Cet article dévoilera toutes les particularités d’Aviator et comment en tirer le meilleur parti.

✈️ Testez Aviator en mode démo

✈️ Aviator en video

✈️ Présentation du jeu Aviator

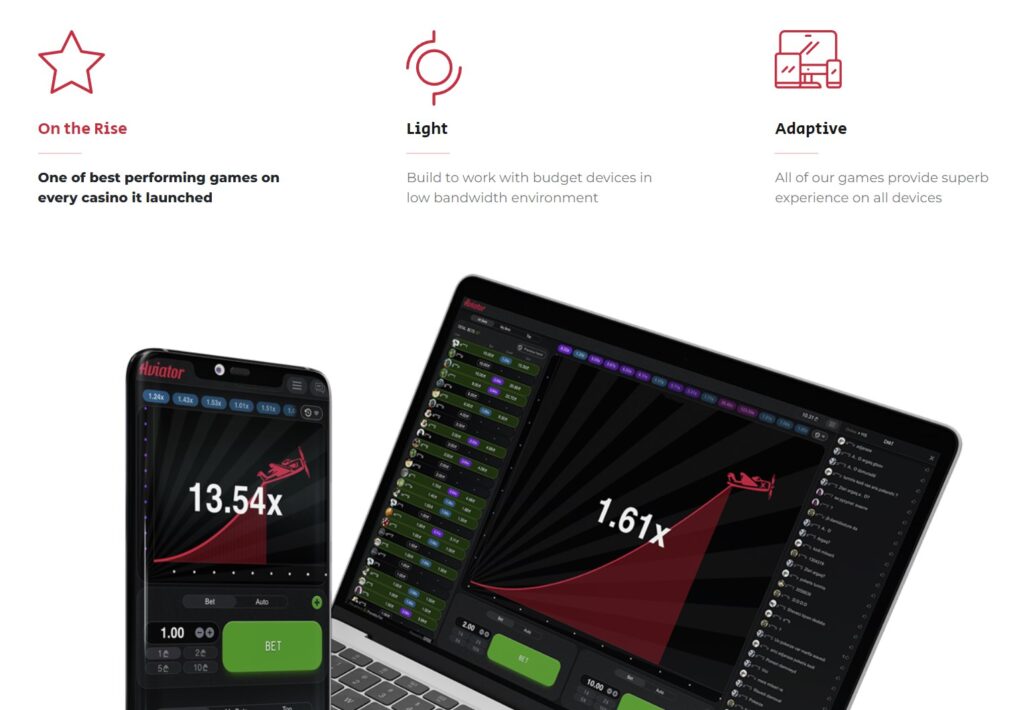

Aviator se distingue par sa simplicité et son accessibilité. Contrairement aux machines à sous traditionnelles, Aviator propose un gameplay plus interactif où chaque joueur a l’impression de contrôler directement ses gains et ses pertes. Le but du jeu est simple : placer un pari avant que l’avion ne décolle et collecter vos gains avant qu’il ne s’envole trop haut.

La popularité d’Aviator provient notamment de son interface graphique épurée mais soignée, ainsi que de ses multiples fonctionnalités conçues pour enrichir l’expérience de jeu. Les joueurs apprécient particulièrement la possibilité de placer deux paris simultanés lors d’un même tour.

Les options de mises doubles

La fonctionnalité la plus attrayante d’Aviator est sans doute l’option de mise double. Les joueurs peuvent choisir de placer deux paris différents dans un même tour, augmentant ainsi leurs chances de gains diversifiés. Par exemple, il est possible de viser un gain modéré avec une mise et tenter une récompense plus élevée avec l’autre.

Cette stratégie permet de limiter les risques tout en laissant place à la possibilité de décrocher un jackpot. C’est particulièrement utile pour ceux qui aiment varier leur approche sans augmenter le montant global de leur mise initiale.

✈️ Communauté et interactivité

L’une des caractéristiques marquantes d’Aviator est son aspect social. Le jeu intègre une fonction de chat en direct qui permet aux joueurs de discuter entre eux pendant les parties. Cela crée une atmosphère communautaire qui rapproche les joueurs malgré la distance.

En outre, Aviator affiche les mises placées par les autres joueurs en temps réel, ajoutant une dimension pédagogique. Voir comment les autres joueurs parient peut offrir de nouvelles perspectives et inspirer des stratégies différentes.

Statistiques en direct

Afin d’aider les joueurs à prendre des décisions informées, Aviator met à disposition une multitude de statistiques en direct. Ces informations incluent les détails des paris en cours, les résultats passés et les mises effectuées depuis le début de la session.

Ces données sont précieuses pour affiner votre stratégie de jeu et maximiser vos chances de succès. Grâce à cette transparence, les joueurs peuvent évaluer leurs performances et ajuster leurs tactiques en conséquence.

✈️ Tester Aviator gratuitement

Pour ceux qui souhaitent découvrir le jeu sans risquer de perdre de l’argent, Aviator propose un mode démo. Disponible sur plusieurs casinos en ligne, ce mode permet de jouer gratuitement et de se familiariser avec les mécaniques du jeu.

C’est une excellente opportunité pour tester différentes stratégies et comprendre les subtilités du jeu avant de passer aux paris réels. La transition vers le jeu payant sera ainsi plus fluide et moins intimidante pour les nouveaux joueurs.

Casinos proposant Aviator

- Casino Extra : Connu pour sa ludothèque impressionnante et ses bonus attractifs, Casino Extra est un excellent choix pour jouer à Aviator.

- Cbet : Pionnier dans les mini-jeux et les jeux crash, Cbet offre une plateforme fiable pour profiter d’Aviator.

- Casinozer : Avec une vaste sélection de jeux et une réputation solide, Casinozer propose également Aviator avec des bonus intéressants et des tours gratuits.

✈️ Techniques de jeu et stratégies

Bien que la victoire à long terme soit incertaine, diverses techniques peuvent améliorer les chances de gagner à court terme sur Aviator. L’une des méthodes les plus couramment utilisées est la martingale, une stratégie de paris progressifs connue de nombreux joueurs de casino.

La martingale consiste à doubler sa mise après chaque perte afin de récupérer les pertes précédentes lorsqu’un gain survient. Cependant, cette méthode comporte des risques et nécessite une gestion rigoureuse de la bankroll pour éviter de lourdes pertes.

Conseils pratiques pour les joueurs

Voici quelques conseils pratiques pour optimiser votre expérience de jeu sur Aviator :

- Fixez un budget : Avant de commencer à jouer, définissez un budget clair pour éviter les pertes excessives.

- Apprenez à lire les statistiques : Utilisez les données disponibles pour comprendre les tendances et adapter vos paris en conséquence.

- Profitez du mode démo : Familiarisez-vous avec le jeu sans risque financier pour peaufiner vos stratégies.

- Mixez les stratégies : Diversifiez vos approches en alternant les mises sûres et les paris plus audacieux.

Ajouter un commentaire